欢迎来到人工智能时代。

发现隐藏在数据海洋中的洞察力可以改变整个行业,从个性化癌症治疗到帮助虚拟个人助理自然交谈和预测下一场大飓风。

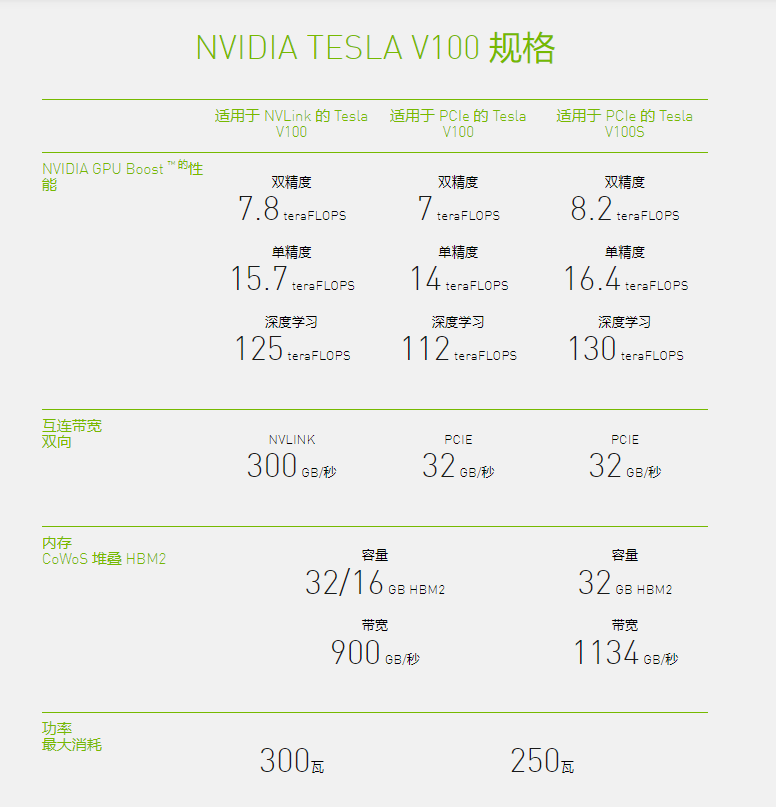

NVIDIA ® Tesla ® V100 Tensor Core 是有史以来最先进的数据中心 GPU,用于加速人工智能、高性能计算 (HPC)、数据科学和图形。它采用NVIDIA Volta 架构,提供 16GB 和 32GB 配置,并在单个 GPU 中提供高达 100 个 CPU 的性能。数据科学家、研究人员和工程师现在可以花更少的时间优化内存使用,而将更多时间用于设计下一个 AI 突破。

人工智能培训

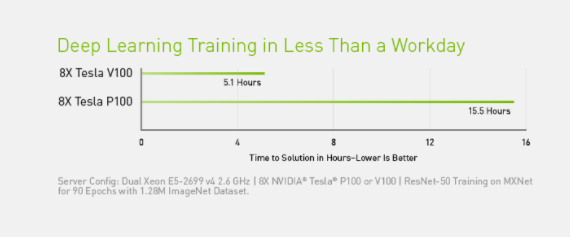

从识别语音到训练虚拟个人助理,再到教授自动驾驶汽车,数据科学家正面临着越来越复杂的人工智能挑战。解决这类问题需要在实际时间内训练复杂性呈指数增长的深度学习模型。

从识别语音到训练虚拟个人助理,再到教授自动驾驶汽车,数据科学家正面临着越来越复杂的人工智能挑战。解决这类问题需要在实际时间内训练复杂性呈指数增长的深度学习模型。

Tesla V100拥有 640 个Tensor Core,是世界上第一款突破 100 teraFLOPS (TFLOPS) 深度学习性能障碍的 GPU。下一代NVIDIA NVLink™以高达 300 GB/s 的速度连接多个 V100 GPU,以创建世界上最强大的计算服务器。在以前的系统上会消耗数周计算资源的 AI 模型现在可以在几天内完成训练。随着训练时间的大幅减少,人工智能现在可以解决一个全新的问题世界。

人工智能推理

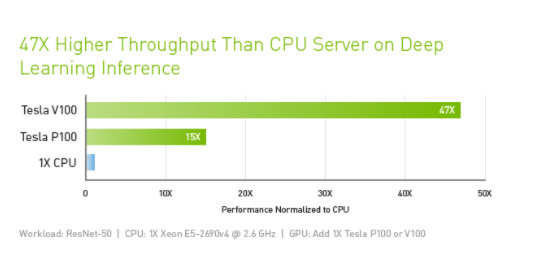

为了将我们与最相关的信息、服务和产品联系起来,超大规模公司已经开始利用人工智能。然而,跟上用户需求是一项艰巨的挑战。例如,世界上最大的超大规模公司最近估计,如果每个用户每天只花三分钟使用他们的语音识别服务,他们将需要将数据中心容量增加一倍。

为了将我们与最相关的信息、服务和产品联系起来,超大规模公司已经开始利用人工智能。然而,跟上用户需求是一项艰巨的挑战。例如,世界上最大的超大规模公司最近估计,如果每个用户每天只花三分钟使用他们的语音识别服务,他们将需要将数据中心容量增加一倍。

Tesla V100 旨在在现有的超大规模服务器机架中提供最高性能。Tesla V100 GPU 以 AI 为核心,提供比 CPU 服务器高 30 倍的推理性能。吞吐量和效率的巨大飞跃将使 AI 服务的横向扩展变得切实可行。

高性能计算 (HPC)

HPC 是现代科学的基本支柱。从预测天气到发现药物再到寻找新能源,研究人员使用大型计算系统来模拟和预测我们的世界。AI 允许研究人员分析大量数据以获得快速洞察力,从而扩展了传统的 HPC,而仅凭模拟无法完全预测现实世界。

HPC 是现代科学的基本支柱。从预测天气到发现药物再到寻找新能源,研究人员使用大型计算系统来模拟和预测我们的世界。AI 允许研究人员分析大量数据以获得快速洞察力,从而扩展了传统的 HPC,而仅凭模拟无法完全预测现实世界。

Tesla V100 专为 AI 和 HPC 的融合而设计。它为 HPC 系统提供了一个平台,可以在用于科学模拟的计算科学和用于发现数据洞察的数据科学方面表现出色。通过在统一架构内配对 NVIDIA CUDA ® 内核和Tensor 内核,配备 Tesla V100 GPU 的单个服务器可以替代数百台商用 CPU,用于传统 HPC 和 AI 工作负载。现在,每位研究人员和工程师都可以负担得起一台人工智能超级计算机来处理他们最具挑战性的工作。

数据中心 GPU

用于 NVLINK 的 NVIDIA TESLA V100 适用于 PCle 的 NVIDIA TESLA V100

深度学习的终极性能。 适用于所有工作负载的最高通用性。